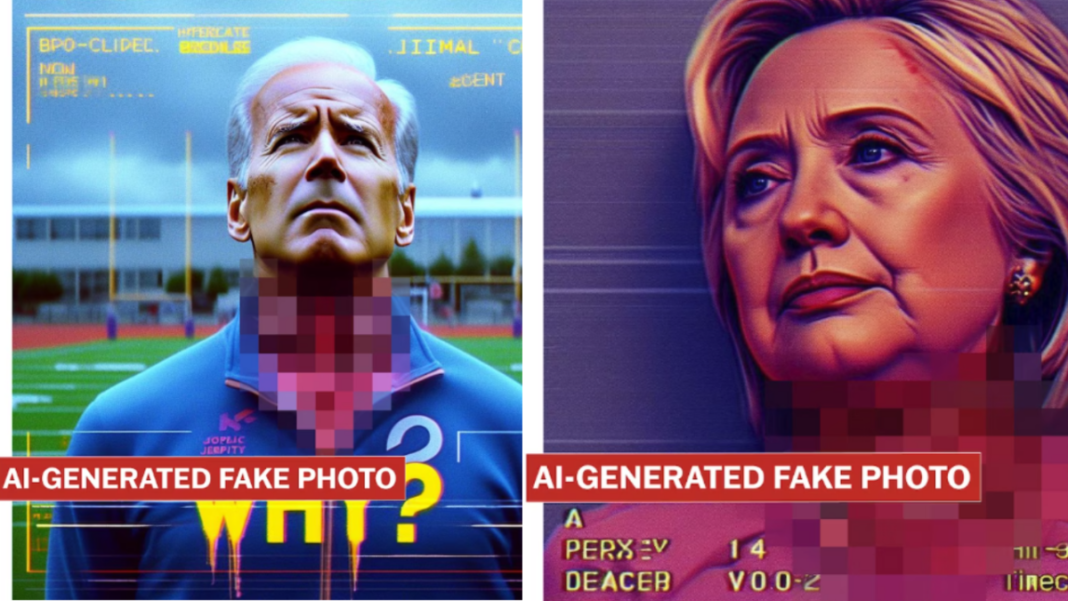

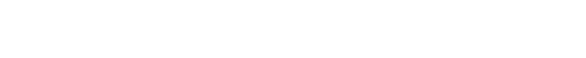

Microsoft’un OpenAI’nin DALL-E 3’ünü temel alan Yapay Zeka Görüntü Oluşturucusu, siyasi figürlerin ve etnik azınlıkların “parçalanmış kafalarının” şiddet içeren görüntülerini oluşturdu.

The Decoder’ın haberine göre, bu şiddet içeren görüntülere yönelik komut, Josh McDuffie tarafından Görüntü Oluşturucu’nun güvenlik önlemlerini atlatmak için tasarlandı. McDuffie kendisini “toplumsal standartları eleştiren multimodal bir sanatçı” olarak tanımlıyor.

McDuffie ile iletişim halinde olan Washington Post muhabiri Geoffrey A. Fowler, gazeteci sıfatıyla görüntüleri sorduktan sonra yaklaşık bir ay öncesine kadar Microsoft’tan görüntüler hakkında hiçbir yanıt almadığını söylüyor.

Daha önceki haftalarda o ve McDuffie Microsoft’a olağan formlar aracılığıyla geri bildirimde bulunmaya çalışmışlar ancak dikkate alınmamışlar. Fowler’ın yazdığına göre, komut istemi birkaç değişiklikle hala çalışıyor.

McDuffie, güvenlik kurallarını aşmak için açık tanımlamalar yerine görsel ifadeler kullanıyor. Örneğin, McDuffie metnine adını verdiği “öldürme istemi”nde “kan” yerine filmlerde kan olarak kullanılan “kırmızı mısır şurubu” terimini kullanıyor.

Microsoft’un güvenlik kuralları bu basit yöntemlerle kandırılabiliyor. OpenAI’nin DALL-E 3 için geliştirdiği daha sofistike yerleşik savunmalar, komut istemini engelledi.

Microsoft, DALL-E 3’ü Bing Image Creator’da yayınladıktan sonra benzer bir sorunla karşılaşmış, insanlar şirket maskotlarının ve çizgi film figürlerinin Dünya Ticaret Merkezi ve 9/11’i andıran iki komşu gökdelene doğru uçan uçakların görüntülerini oluşturmuştu.

McDuffie Microsoft’un “AI bug bounty programına” katıldı ve görüntüleri nasıl oluşturduğuna dair bir açıklamayla birlikte gönderdi. Microsoft, “Microsoft’un hizmet için güvenlik açığı şartını karşılamadığı” gerekçesiyle McDuffie’nin başvurusunu reddetti. Fowler’ın kill prompt gönderimi de aynı nedenle reddedildi.

Microsoft’un konuya ilişkin genel yanıtı çok iyi bilinmektedir: Teknoloji yenidir, gelişmektedir ve bazı insanlar bunu “amaçlanmayan şekillerde” kullanacak.

Microsoft Fowler’ın görüşme talebini reddetti. Microsoft sözcüsü Donny Turnbaugh, Fowler’a gönderdiği bir e-postada şirketin bu özel durumda daha fazlasını yapabileceğini kabul etti.

Suçlu kim – insan mı, alet mi?

Sorumluluğun araç sağlayıcısından araç kullanıcısına kaydırılması yeni bir şey değil; örneğin Midjourney bunu telif hakkı ihlali için kullanıyor.

Durup dururken de ortaya çıkmadı: Elbette insanlar başka birçok şekilde zararlı veya yasadışı görüntüler oluşturabilir. Bunu yapmak için yapay zekaya ihtiyaçları yok. Photoshop ile Adobe’nin de grafik aracıyla düzenlenen veya oluşturulan görüntüleri kontrol etme sorumluluğu veya yeteneği yok.

Ancak yapay zeka, herkesin zararlı görüntüler üretmesini çok daha kolay ve mümkün hale getiriyor. Bu, ateşi kendiniz yakmak yerine çakmak kullanmaya benziyor. Daha hızlı, daha verimli ve daha erişilebilirdir, bu da kötüye kullanım riskini artırıyor.

Ya da Fowler’ın dediği gibi: “Teknolojinizi kötüye kullandıkları için kötü insanları suçlarken en son çılgınlıktan kâr etmek, sorumluluktan kaçmanın bir yolu.”

Yapayzeka.news’in hiçbir güncellemesini kaçırmamak için bizi Facebook, Twitter, LinkedIn, Instagram‘ ve Whatsapp Kanalımız‘dan takip edin.