Bir görüntü, bir ses parçası ve gerçeğinden neredeyse ayırt edilemeyen dudak senkronize deepfake’iniz hazır. Alibaba’nın en son yapay zeka modeli “EMO” henüz kullanıma sunulmadı, ancak sonuçları açık.

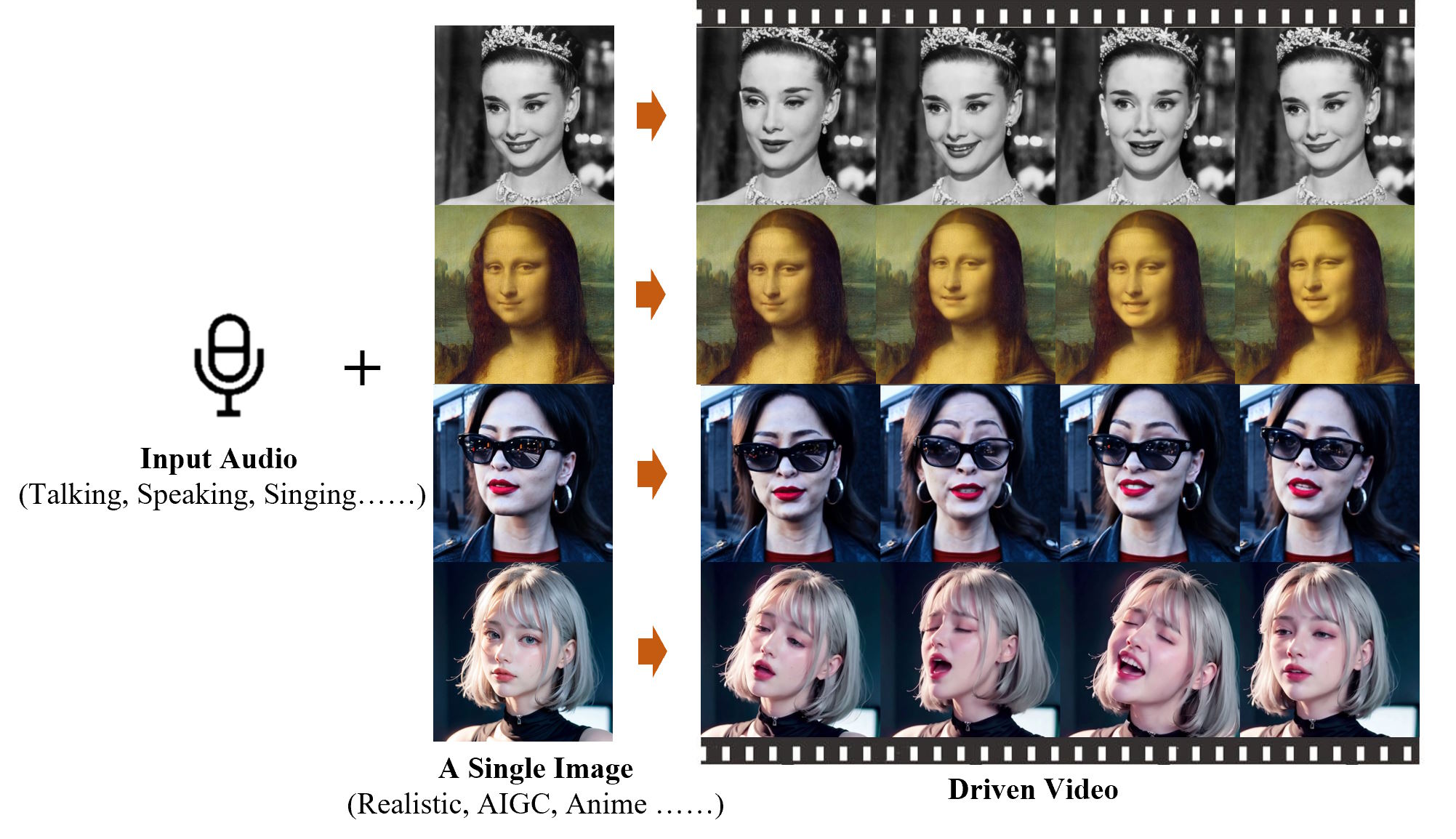

Alibaba Group’taki araştırmacılar, konuşan video kafaların gerçekçiliğini ve ifade gücünü artıran EMO adlı yeni bir çerçeve geliştirdiler. EMO, ara 3B modellere veya yüz işaretleyicilerine olan ihtiyacı ortadan kaldırarak Stable Diffusion’a dayalı doğrudan bir ses-video sentezleme yaklaşımı kullanıyor. Yöntem, kareler arasında kesintisiz geçişler ve videoda tutarlı karakter temsili sağlıyor.

EMO, çizgi filmden animeye ve canlı aksiyona kadar çeşitli stillerde ve farklı dillerde hem konuşan hem de şarkı söyleyen videolar oluşturabilir ve mevcut yöntemlerden önemli ölçüde daha iyi performans gösteriyor. İster Audrey Hepburn, ister Mona Lisa, hatta ünlü Sora demo videosundaki Japon kadın olsun, dudakları ve yüz kaslarını hareket ettirmek için tek bir görüntü ve film müziği yeterli.

Araştırmacılar için en büyük zorluklardan biri, model tarafından üretilen videoların istikrarsızlığıydı; bu durum genellikle video kareleri arasında yüz bozulması veya titreme şeklinde kendini gösteriyordu. Bu sorunu çözmek için hız kontrolörü ve yüz alanı kontrolörü gibi kontrol mekanizmalarını entegre ettiler. Bu kontroller hiperparametreler olarak hareket ediyor ve nihai olarak üretilen videoların çeşitliliğini ve ifade gücünü etkilemeyen ince kontrol sinyalleri olarak hizmet ediyor.

Özel eğitim veri seti ile 250 saatlik çekim

EMO, 250 saatten fazla materyal ve 150 milyondan fazla görüntü içeren özel bir ses-video veri kümesi üzerinde eğitildi. Bu kapsamlı veri seti, konuşmalar, film ve TV klipleri ve birden fazla dilde ses kayıtları dahil olmak üzere geniş bir içerik yelpazesini kapsıyor. Araştırmacılar makalelerinde verilerin tam kaynağını açıklamıyor.

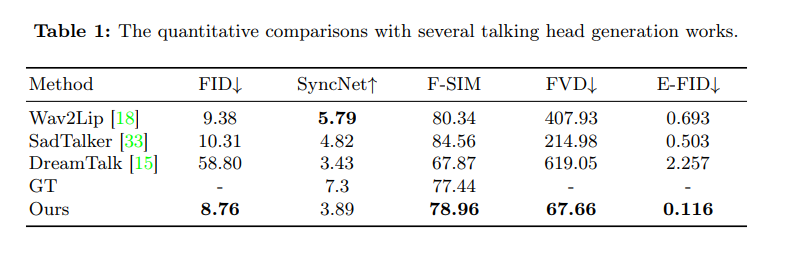

İnsan Diyaloğu Konuşan Yüz (HDTF) veri setiyle yapılan kapsamlı deney ve karşılaştırmalarda EMO yaklaşımı, Fréchet Başlangıç Mesafesi (FID), SyncNet, F-SIM ve FVD dahil olmak üzere çeşitli ölçütlerde mevcut en iyi rakip yöntemlerden daha iyi performans gösterdi.

EMO video üretimi alanında önemli bir ilerlemeyi temsil ederken, araştırmacılar bazı sınırlamaları kabul ediyor. Yöntem, difüzyon modellerine dayanmayan diğer yöntemlere göre daha fazla zaman alıyor. Ayrıca, figürün hareketini yönlendirecek açık kontrol sinyalleri olmadan, model yanlışlıkla başka vücut parçaları oluşturabilir. Gelecekteki çalışmalar muhtemelen bu zorlukları ele alacak.

Alibaba Group’un bu araştırmayı uygulayıp uygulamayacağı ve kullanıcıların kullanımına sunup sunmayacağı belli değil. Bu tür teknolojiler, çok kısa sürede gerçekçi deepfake videolar oluşturmak ve çok sayıda ses deepfake aracından biriyle birlikte, örneğin politikacıların ağzına her türlü kelimeyi yerleştirmek için kullanılabilirlerse, kötüye kullanım için muazzam bir potansiyel sunuyor. Özellikle 2024 ABD seçim yılında, uzmanlar deepfake’lerin riskleri konusunda çok endişeli.

Ancak bu gelişmeler eğlence için de heyecan verici ve TikTok gibi sosyal medya uygulamalarında ya da daha gerçekçi dublaj için film endüstrisinde kullanılabilir.

Son zamanlarda, aralarında yapay zeka girişimi Pika Labs’ın da bulunduğu birkaç şirket yapay zeka dudak senkronizasyonu üzerinde çalışıyor. Gelecek vaat eden bir yapay zeka video modeli sunan şirket, kısa süre önce ürününe dudak senkronizasyonunu ekledi.

Bu alanda öne çıkan bir diğer oyuncu da geçen yıl ses klonlama ve dudak senkronizasyonunun ikna edici bir kombinasyonuyla sükse yapan HeyGen.

Kaynak: The-Decoder

Yapayzeka.news’in hiçbir güncellemesini kaçırmamak için bizi Facebook, X (Twitter), Bluesky, LinkedIn, Instagram‘ ve Whatsapp Kanalımız‘dan takip edin.