OpenAI, metin, görüntü ve ses işlemeyi tek bir sinir ağında birleştirerek performans ve verimlilikte yeni standartlar belirleyen en yeni büyük multimodal modeli GPT-4o’yu tanıttı.

GPT-4o’daki “o”, “omni” anlamına geliyor ve modelin aynı sinir ağı aracılığıyla birden fazla girdi ve çıktı türünü işleme yeteneğini yansıtıyor.

GPT-4o’nun en önemli özelliklerinden biri de etkileyici ses yetenekleri. Model, ses girdisine ortalama 232 milisaniye gibi kısa bir sürede yanıt verebiliyor ki bu da insanların konuşma sırasındaki yanıt süreleriyle karşılaştırılabilir. Buna karşılık, eski modellerin yanıt vermesi 2,8 ila 5,4 saniye arasında sürüyordu.

OpenAI, GPT-4o’nun ayrıca sakin ve heyecanlı nefesleri ayırt edebildiğini, sentetik konuşmada çeşitli duyguları ifade edebildiğini ve hatta sesini robotik bir sese dönüştürebildiğini veya istek üzerine şarkı söyleyebildiğini gösterdi.

OpenAI’ye göre GPT-4o, metin performansı açısından GPT-4 Turbo ile İngilizce’de eşleşiyor ve İngilizce olmayan dillerde önemli ölçüde daha iyi performans gösteriyor. Modelin görme yetenekleri, video veya grafikleri gerçek zamanlı olarak analiz etmesine, yüzlerdeki duyguları tanımasına ve tanımlamasına ve buna göre tepki vermesine olanak tanıyor.

GPT-4o, GPT-4 Turbo’dan daha verimli ve daha ucuzdur

Verimlilik, GPT-4o’nun geliştirilmesinde önemli bir odak noktasıydı ve OpenAI, yeni modelin selefi GPT-4 Turbo’dan iki kat daha hızlı ve %50 daha ucuz olduğunu iddia ediyor.

OpenAI, GPT-4o’yu ChatGPT’de ücretsiz olarak kullanıma sunarak en son AI modellerine erişimi genişletiyor, ancak ücretsiz kullanıcılar için ödeme yapan müşteriler ve API kullanıcılarına kıyasla bazı daha düşük oran limitleri var. ChatGPT’nin ücretli kullanıcıları beş kat daha yüksek bir oran limitine sahip.

Yine de OpenAI’ye göre dünyanın en iyisi olan GPT-4 seviyesindeki bir model ilk kez ücretsiz olarak halka sunuluyor.

Geliştiriciler GPT-4o’yu API’de bir metin ve “görüntü” modeli olarak kullanabilirken, önümüzdeki haftalarda ses ve video özelliklerini seçkin bir grup güvenilir ortağın kullanımına sunmayı planlıyor.

OpenAI CEO’su Sam Altman, “OpenAI’yi başlattığımızda ilk düşüncemiz yapay zeka yaratacağımız ve bunu dünya için her türlü faydayı yaratmak için kullanacağımızdı. Bunun yerine, şimdi biz yapay zekayı yaratacağız ve sonra diğer insanlar onu hepimizin yararlanacağı her türlü harika şeyi yaratmak için kullanacak gibi görünüyor” diye yazdı.

GPT-4o, GPT-4 Turbo’dan daha iyi performans gösteriyor

GPT-4o’nun performansını göstermek için OpenAI, modeli dil modelleri için bir kıyaslama olan LMSys Arena’da test etti. OpenAI araştırmacısı William Fedus’a göre model, selefi GPT-4 Turbo’dan yaklaşık 60 ELO puanı daha iyi performans gösterdi.

ELO puanı, modelin gerçek çıktısı kullanılarak insanlar tarafından kör bir testte değerlendirildiğinden, şu anda bir modelin performansının en önemli göstergelerinden biri olarak kabul ediliyor. ELO, başlangıçta satrançta göreceli oyun gücünü ölçmek için kullanılan bir derecelendirme sistemi. ELO derecesi ne kadar yüksekse, bir oyuncu (ya da bu durumda bir yapay zeka modeli) karşılaştırıldığında o kadar iyi performans gösteriyor. Veriler, OpenAI’nin kısa bir süre önce modelin takma bir isim altında yarışmasına izin verdiği Chatbot Arena’dan geliyor.

Fedus, GPT-4o’nun selefinden 100 puan daha yüksek bir ELO puanı elde ettiği zorlu görevlerde, özellikle de programlamada avantajın daha da önemli olduğunu söyledi.

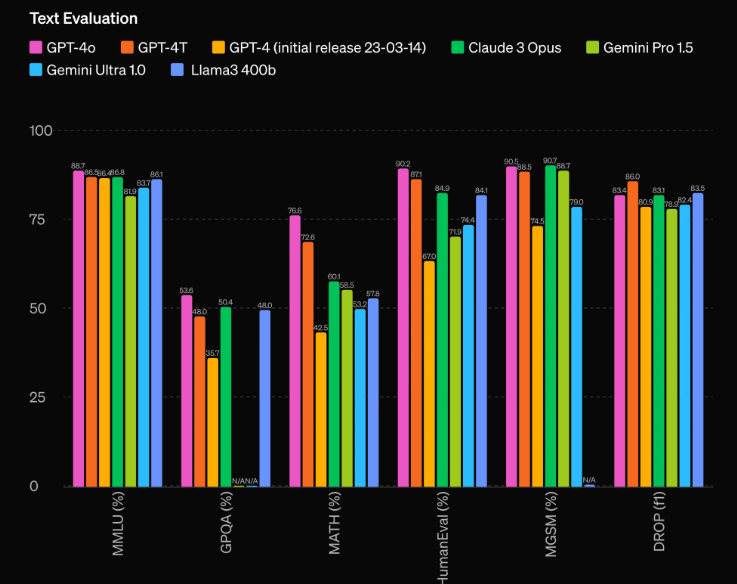

OpenAI’ye göre GPT-4o, GPT-4 Turbo’nun geleneksel metin, akıl yürütme ve programlama ölçütlerindeki performansıyla eşleşiyor, ancak çok dilli, sesli ve görsel anlama için yeni ölçütler belirliyor.

Örneğin, GPT-4o Genel Bilgi testinde (MMLU, 5-Shot) yüzde 87,2’lik yeni bir yüksek puan aldı. Ayrıca GPT-4 ve diğer modeller konuşma tanıma ve çeviride ve diyagram içeren görevlerde (M3Exam) önemli ölçüde daha iyi performans gösterdi. OpenAI, GPT-4o’nun görsel algı testlerinde de yeni standartlar belirlediğini söylüyor.

GPT-4o için yeni bir belirteçleyici, dilleri daha verimli bir şekilde belirteçlere ayırabilir, özellikle Latin olmayan komut dosyaları için işlemeyi hızlandırıyor ve bellek gereksinimlerini azaltıyor. Örneğin, “Merhaba, benim adım GPT-4o” cümlesi Telugu dilinde eskisine göre 3,5 kat, Almanca dilinde ise 1,2 kat daha az belirteç gerektiriyor.

OpenAI duyurusunu GPT-4o üzerine odakladı. OpenAI CTO’su Mira Murati sahnede yaptığı açıklamada, bir sonraki büyük model hakkında bilgilerin yakında geleceğini söyledi.

ChatGPT masaüstü uygulamasına kavuşuyor

OpenAI ayrıca ChatGPT için MacOS’ta yeni bir masaüstü uygulaması ve bunu takip edecek bir Windows sürümü ile deneyimi daha kullanıcı dostu ve diyaloğa dayalı hale getirmek için güncellenmiş bir web tasarımı sundu.

Uygulama, klavye kısayolları aracılığıyla ChatGPT’ye hızlı erişim sağlar ve kullanıcılar ekran görüntülerini doğrudan uygulama içinde tartışabilir. Bir ses modu ChatGPT ile konuşmalara olanak tanır ve GPT-4o’nun ses ve video özelliklerinin entegrasyonu gelecekte planlanmaktadır.

Güvenlik, kullanılabilirlik ve sınırlar

OpenAI’ye göre GPT-4o’nun güvenliği, örneğin eğitim verilerini filtreleyerek veya eğitimden sonra davranışı optimize ederek tüm girdi türleri için sıfırdan yeniden tasarlandı. Ses çıkışı için de yeni güvenlik sistemleri oluşturuldu.

OpenAI, GPT-4o’yu kendi Hazırlık Çerçevesine göre ve yeni modalitelerin yarattığı riskleri belirlemek ve azaltmak için bugüne kadar 70 dış uzmanın yardımıyla değerlendirdi. Şimdilik sadece metin ve görüntü girişi ile metin çıktısı kamuya açık olacak.

Diğer giriş türleri, teknik altyapı, kullanılabilirlik ve güvenlik sağlandığında bunu takip edecek. GPT-4o ile yeni ses modunun alfa sürümü önümüzdeki haftalarda ChatGPT Plus’ta yayınlanacak.

Şirket, ilerlemeye rağmen GPT-4o’nun birden fazla adım içeren karmaşık görevler veya bağlam ve nüansı anlama gibi sınırlamaları olduğunu söylüyor. OpenAI, modeli daha da geliştirmek için geri bildirim arıyor.

Kaynak: Matthias Bastian / The-Decoder

Yapayzeka.news’in hiçbir güncellemesini kaçırmamak için bizi Facebook, X (Twitter), Bluesky, LinkedIn, Instagram ve Whatsapp Kanalımız‘dan takip edin.