Databricks, GPT-3.5, Grok, Mixtral ve Llama 2’den daha iyi performans gösteren yeni ve güçlü bir açık dil modeli olan DBRX’i tanıttı. Şirket, yapay zeka endüstrisinde daha fazla şeffaflık ve açık modellere yönelik eğilimi yönlendirmeyi amaçlıyor.

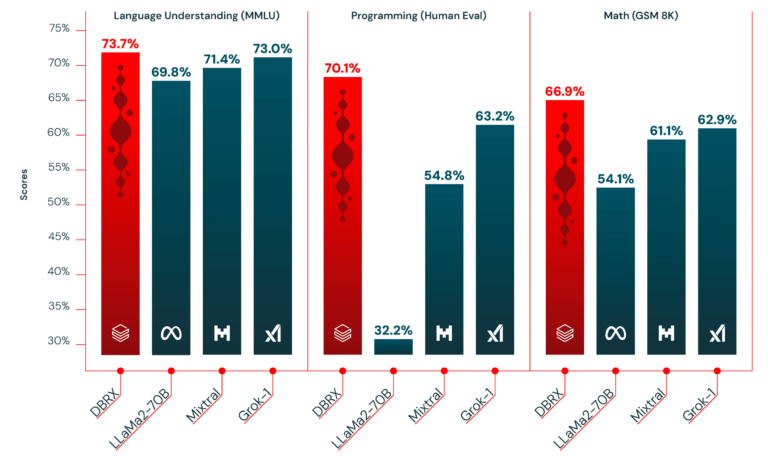

Teknoloji şirketi Databricks, yerleşik açık kaynak modellerinden daha iyi performans gösterdiğini iddia ettiği yeni bir açık dil modeli olan DBRX’i piyasaya sürdü. Standartlaştırılmış kıyaslama testlerinde DBRX, Meta’nın Llama 2, Anthropic’in Mixtral ve hatta Elon Musk’ın xAI’sinin yakın zamanda piyasaya sürülen Grok-1 modelinden daha iyi performans gösterdi. DBRX ayrıca çoğu kıyaslamada OpenAI’nin GPT 3.5 modelinden daha iyi performans gösterdi.

Hugging Face Open LLM Leaderboard ve Databricks Model Gauntlet gibi bileşik kıyaslamalarda DBRX, test edilen tüm modeller arasında en iyi sonuçları elde etti. DBRX ayrıca programlama ve matematik gibi alanlarda da mükemmel performansa sahip.

Databricks’e göre DBRX, şu anda OpenAI’nin en güçlü kapalı dil modeli olan GPT-4’e bile yakın kalitede.

Bununla birlikte, model tamamen açık kaynak değil; kullanım kurallarını belirleyen bir lisansla birlikte geliyor ve eğitim verileri mevcut değil. Açık kaynak gözlemcilerine göre açık kaynak olmayan Meta’nın Llama 2’sine benzer şekilde açık bir model olarak sınıflandırılması daha olası. Ayrıca özel ve ticari kullanıma izin veriliyor.

Buna ek olarak, ekip DBRX’i Alibaba’nın QWen1.5’i gibi diğer modellere karşı test etmedi, bu da kıyaslamalara göre en azından MMLU kıyaslamasında yeni modelden daha iyi performans gösteriyor.

DBRX, Uzmanların Karışımına dayanıyor

DBRX, 132 milyar parametreye sahip bir uzmanlar karışımı modelidir ve herhangi bir zamanda yalnızca 36 milyarı aktiftir, bu da saniye başına belirteç açısından yüksek verimlilik sağlıyor. Model, 3.072 Nvidia H100 GPU üzerinde 12 trilyon token metin ve kod ile maksimum 32.000 token bağlam penceresi ile eğitildi. Duyuruya göre, yüksek veri kalitesi ve donanım kullanımını iyileştirmek için model mimarisinde yapılan ayarlamaların birleşimi, eğitim verimliliğinde yüzde 50’ye varan bir artışa yol açtı.

Buna ek olarak Databricks, müşterilerin DBRX’i Databricks platformunda kullanmalarına ve özelleştirmelerine ve kendi modellerini özel veriler üzerinde eğitmelerine olanak tanıyor. Açık kaynak topluluğu, DBRX’e Databricks GitHub deposu ve Hugging Face aracılığıyla erişebiliyor.

Databricks, açık bir yaklaşım benimseyerek üretken yapay zekada inovasyonu teşvik etmeyi ve yapay zeka modellerinin geliştirilmesine daha fazla şeffaflık getirmeyi amaçlıyor. Databricks, şirketler daha fazla verimlilik ve kontrol elde etmek için tescilli modelleri özelleştirilebilir açık kaynaklı modellerle değiştirdikçe açık LLM’lerin giderek daha önemli hale geldiğini vurguluyor. Databricks, DBRX gibi açık modellerin şirketlerin kendi sektörlerinde daha rekabetçi olmalarına yardımcı olabileceğine inanıyor.

Databricks, DBRX Base ve DBRX Instruct olmak üzere iki varyant sunuyor. Şirket 2023 yılında, ekibi MPT modelleriyle birlikte güçlü, açık dil modelleri yayınlayan MosaicML’i satın aldı.

Yapayzeka.news’in hiçbir güncellemesini kaçırmamak için bizi Facebook, X (Twitter), Bluesky, LinkedIn, Instagram‘ ve Whatsapp Kanalımız‘dan takip edin.