Yapay zeka start-up’ı Reka, GPT-4 ile rekabet edebilen ve metin ve görüntülerin yanı sıra video ve sesi de anlayan Reka Core adlı yeni bir multimodal dil modelini tanıttı.

DeepMind, Google ve Meta’dan araştırmacılar tarafından kurulan San Francisco merkezli yapay zeka girişimi Reka, Reka Core adlı yeni bir çok modlu dil modelini tanıttı. Şirketin “en büyük ve en yetenekli modeli” olarak lanse edilen bu model, binlerce GPU kullanılarak sıfırdan eğitildi.

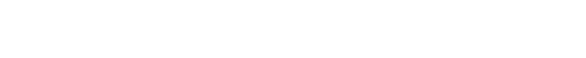

Bugün API, şirket içi veya cihaz içi dağıtım seçenekleriyle sunulan Core, Reka’nın dil modelleri ailesinin üçüncü üyesi ve görüntü, ses ve video dahil olmak üzere çoklu modaliteleri anlama yeteneği sunuyor. En önemlisi, bir yıldan kısa bir sürede eğitilmesine rağmen, OpenAI, Google ve Anthropic gibi yapay zeka alanındaki önde gelen, derin cepli oyuncuların en iyi modellerinin performansıyla eşleşiyor veya onları geride bırakıyor.

22 kişilik şirketin kurucu ortağı ve CEO’su Dani Yogatama, “Yüksek performanslı modelleri çok kısa bir sürede eğitme becerisi şirketi öne çıkarıyor” dedi.

Reka’nın baş bilim adamı ve kurucu ortağı Yi Tay, X’te şirketin Reka Core’u geliştirmek için “binlerce H100” kullandığını yazdı. OpenAI’nin GPT-4 ve Claude 3 Opus’una rakip olmak için sıfırdan bir şey geliştirmek kesinlikle bir başarı. Core’un hala gelişmekte olduğu konusunda uyarıyor, ancak ekip şimdiye kadarki performanstan etkilendi.

It’s been a wild ride. Just 20 of us, burning through thousands of H100s over the past months, we’re glad to finally share this with the world! 💪

One of the goals we’ve had when starting Reka was to build cool innovative models at the frontier. Reaching GPT-4/Opus level was a… https://t.co/ncheAggoQb

— Yi Tay (@YiTayML) April 15, 2024

Reka Core ne getiriyor?

Reka Core’un tam parametre sayısı açıklanmamış olsa da, Yogatama bunu kamuya açık veriler, lisanslı veriler ve metin, ses, video ve görüntü dosyalarını kapsayan sentetik veriler dahil olmak üzere birden fazla kaynaktan eğitilmiş “çok büyük bir model” (sonuncusu olan Reka Flash’ın 21 milyar parametresi vardı) olarak tanımladı.

Bu geniş eğitim kapsamının Core’un girdi olarak çoklu modaliteleri anlamasını ve matematik ve kodlama gibi alanlarda yüksek düzeyde muhakeme ile cevaplar vermesini sağladığını açıkladı. Ayrıca 32 dil desteği ve 128.000 jetonluk bir bağlam penceresi de modelin büyük miktarda farklı bilgiyi tek seferde alıp işlemesini sağlıyor. Bu, uzun dokümanlar üzerinde çalışmak için uygundur. Yogatama, Core’un Google’ın Gemini Ultra’sından sonra metinden videoya kadar tüm modaliteleri kapsayan ve yüksek kaliteli çıktılar sağlayan ikinci model olduğunu söyledi.

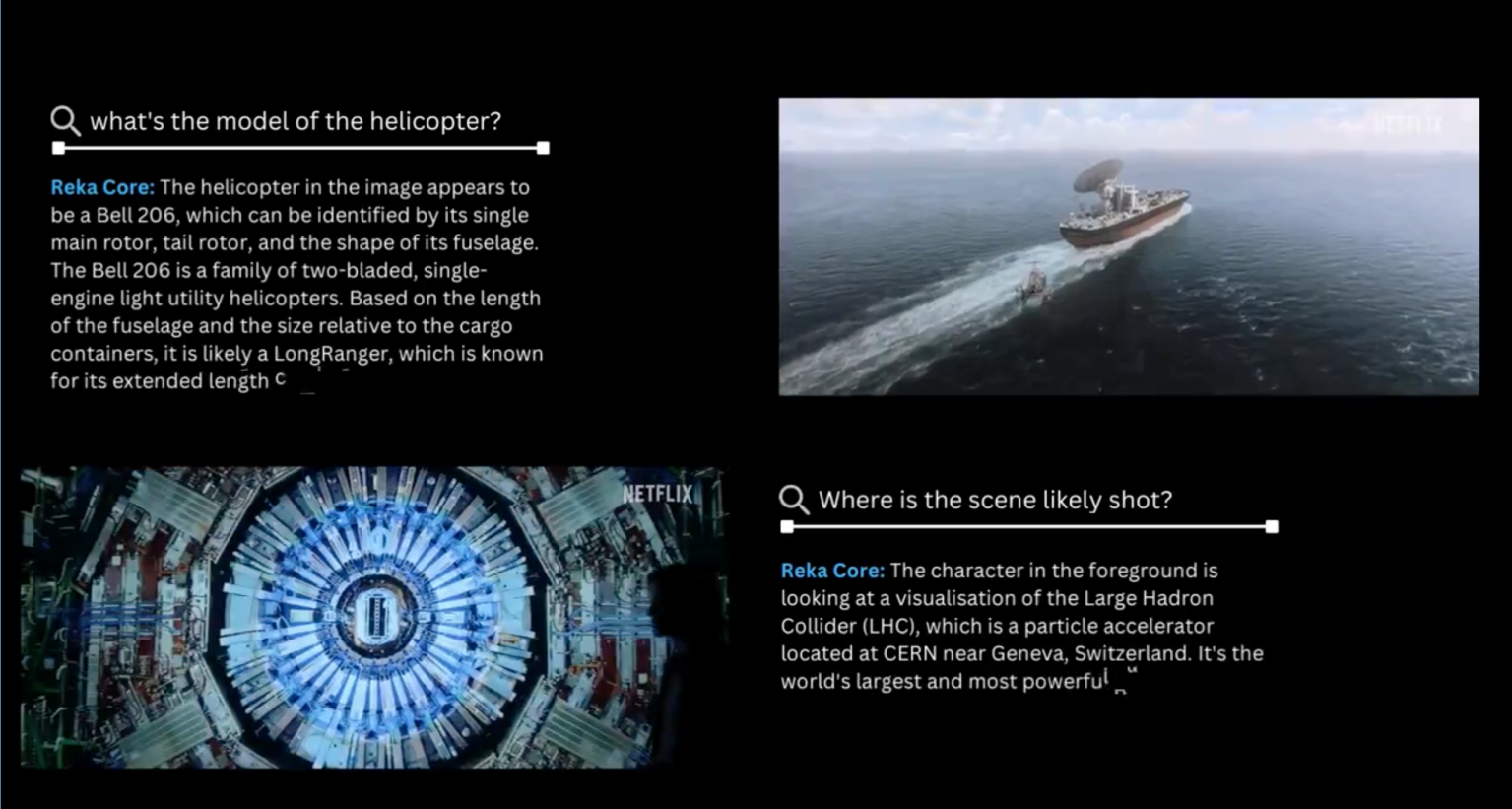

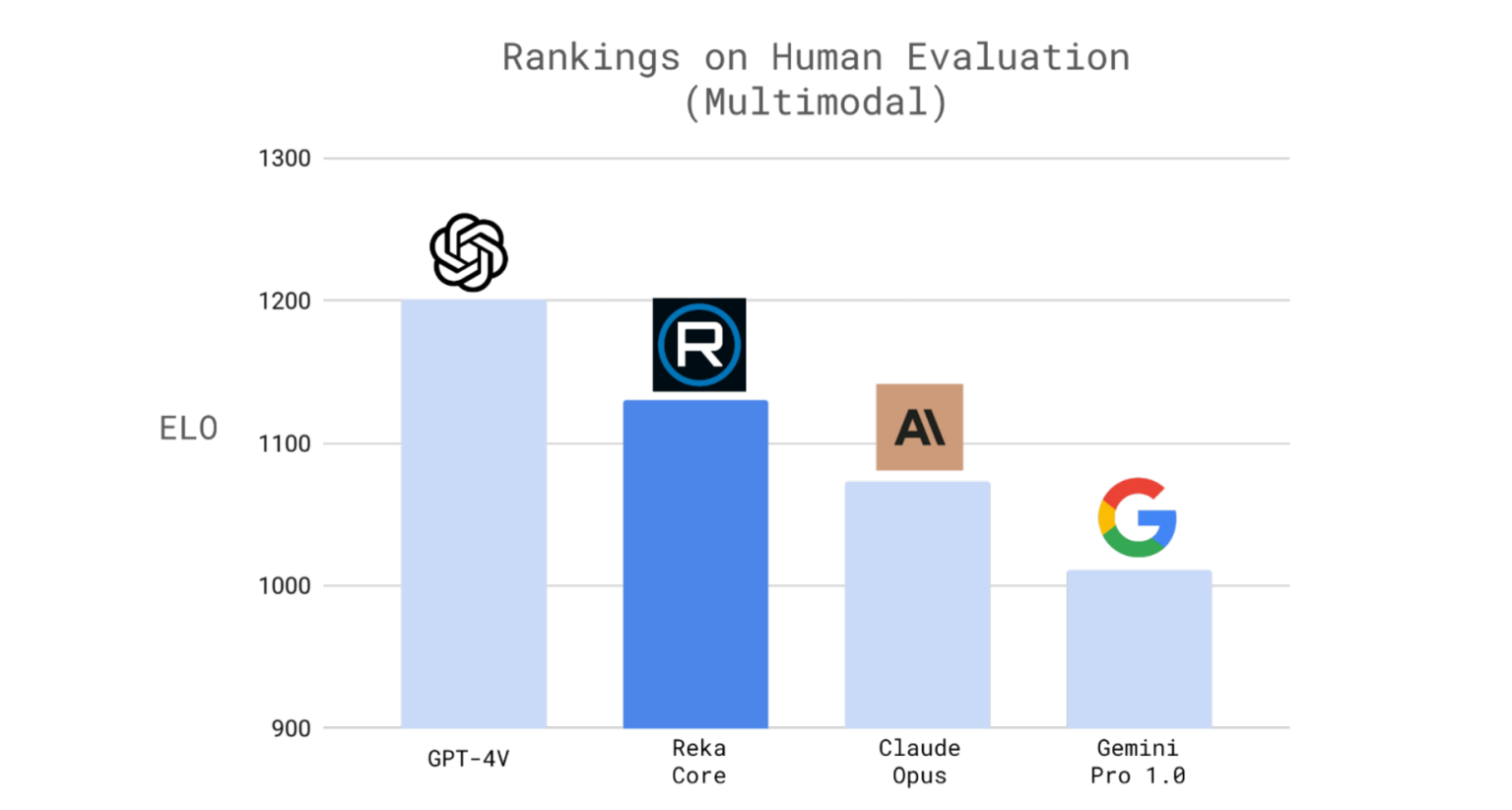

Video için algı testinde Core, tek rakibi Gemini Ultra’dan iyi bir farkla daha iyi performans gösterdi (59,3’e karşı 54,3 puan). Bu arada, görüntü görevleri için MMMU kıyaslamasında, GPT-4 (56.8), Claude 3 Opus (59.4), Gemini Ultra (59.4) ve Gemini Pro 1.5’in (58.5) hemen arkasında 56.3 puanla yer aldı. Elon Musk’ın xAI’si de kısa süre önce Grok’un görüş kabiliyetine sahip bir versiyonunu piyasaya sürdü, ancak bu model 53,6 puanla rakiplerinin gerisinde kaldı.

Diğer kıyaslamalarda bile Core’un sektör lideri oyuncularla eşleştiği görüldü. Örneğin, MMLU bilgi görevleri testinde 83,2 puan alarak GPT-4, Claude 3 Opus ve Gemini Ultra’nın hemen arkasında yer aldı. Bu arada, akıl yürütme için GSM8K ve kodlama için HumanEval kıyaslamasında, sırasıyla 92,2 ve 76,8 puanlarla GPT-4’ü geçmeyi başardı.

Yogatama, çok kısa bir süre içinde bu düzeyde bir performans elde etmek için şirketin baş aşağı bir yaklaşım benimsediğini söyledi. Bu, bir modeli eğitmek ve nereye gittiğini görmek yerine, hedeflenen bir performans seviyesiyle başladıkları ve daha sonra, eğitim için ne kadar veri kullanılması gerektiği ve gerekli GPU sayısı gibi hususları kapsayan, bunu elde etmenin en iyi ve en verimli yolunun ne olması gerektiğini bulmak için geriye doğru çalıştıkları anlamına geliyor.

Boru hattında çoklu ortaklıklar

Reka, tüm modalitelere odaklanarak ve milyon girdi tokenı başına 10 $ ve milyon çıktı tokenı başına 25 $’lık rekabetçi fiyatlandırma ile e-ticaret, oyun, sağlık ve robotik dahil olmak üzere farklı endüstri segmentlerinden müşteriler için yeni ve benzersiz kullanım durumlarının kilidini açmayı umuyor. OpenAI’nin GPT-4 Turbo’su ise girdi tokenları için aynı fiyatlandırmaya sahipken çıktı için 30$’dır.

Reka henüz başlangıç aşamasında olsa da OpenAI, Anthropic ve Google’ın yapay zeka alanındaki hakimiyetini ele geçirmek için elinden geleni yapıyor. Girişim, modellerinin erişimini genişletmek için endüstri ortakları ve kuruluşlarla çalışmaya başladı bile. Snowflake, kısa bir süre önce Reka Core ve Flash’ı LLM uygulama geliştirme için Cortex hizmetine dahil ettiğini duyurdu. Singapur merkezli tüm araştırma kurumlarını ve yapay zeka start-up’ları ve şirketleri ekosistemini bir araya getiren Oracle ve AI Singapore da şirketin modellerini kullanıyor.

Yogatama, Reka ailesindeki ilk modellerin (Flash ve Edge) piyasaya sürülmesinden bu yana şirketin işletmelerden yoğun ilgi gördüğünü ve güçlü bir müşteri hattına sahip olduğunu söyledi. Şirketin önümüzdeki haftalarda ortaklıkları hakkında daha fazla bilgi paylaşacağını da sözlerine ekledi.

Yogatama, şirketin ilk yılının tamamen modelleri pazara sunmakla ilgili olduğunu söyledi. Şimdi, bir sonraki adım olarak, iş fonksiyonlarını hızlandırırken aynı zamanda bu işin üzerine inşa etmek istiyor. Ürün tarafında, şirket Core’u performansını daha da artırmak için eğitiyor ve aynı zamanda bir sonraki sürüm üzerinde çalışıyor.

Bununla birlikte, yapılan tüm çalışmalara rağmen Yogatama, şirketin teknolojiyi açık kaynaklı hale getirme gibi bir planı olmadığını belirtti. Açık kaynağın güçlü bir destekçisi olmaya devam ettiğini ancak bunun bir işletme olarak büyümeye devam etmek için “neyi paylaşıp neyi paylaşmayacağımız arasındaki doğru dengeyi” bulmakla ilgili olduğunu söyledi.

Kaynak: Shubham Sharma / VentureBeat

Yapayzeka.news’in hiçbir güncellemesini kaçırmamak için bizi Facebook, X (Twitter), Bluesky, LinkedIn, Instagram‘ ve Whatsapp Kanalımız‘dan takip edin.