OpenAI, AI tarafından oluşturulan metnin netliğini ve doğrulanabilirliğini artırmak için yeni bir yöntem yarattı. Bu yaklaşım, AI sistemlerine olan güveni artırabilir ve kritik alanlarda kullanımını genişletebilir.

Yöntem, “kanıtlayıcı-doğrulayıcı oyunları”nı kullanır. İki yapay zeka modeli yarışmaktadır: Bir “kanıtlayıcı” bir soruna çözümler üretir ve bir “doğrulayıcı” bunların doğru olup olmadığını kontrol eder.

Amaç, kanıtlayıcıyı doğrulayıcının anlayabileceği çözümler üretmesi için eğitmektir. OpenAI, bunun çözümleri insanlar için daha anlaşılır ve doğrulanabilir hale getirdiğini söylüyor.

Çalışma, kanıtlayıcı olarak daha güçlü bir GPT-4 modeli ve doğrulayıcı olarak çok daha zayıf bir GPT-4 modeli kullandı. Kanıtlayıcı, eğitim sırasında “yardımcı” ve “gizli” roller arasında dönüşümlü olarak çalıştı.

Yardımcı olduğunda, doğrulayıcı doğru çözümler için ödüllendirildi. Sinsi olduğunda, doğrulayıcıyı kandıran yanlış çözümler için ödüllendirildi.

Başlangıçta, hileli kanıtlayıcı doğrulayıcıyı yanlış cevaplarla kolayca kandırdı. Ancak ileri geri eğitim doğrulayıcıya ince hataları fark etmeyi öğretti. Bu, kanıtlayıcıyı her seferinde yeni taktikler denemeye itti. Eğitim, kanıtlayıcı doğrulayıcıyı artık kandıramadığında sona eriyor.

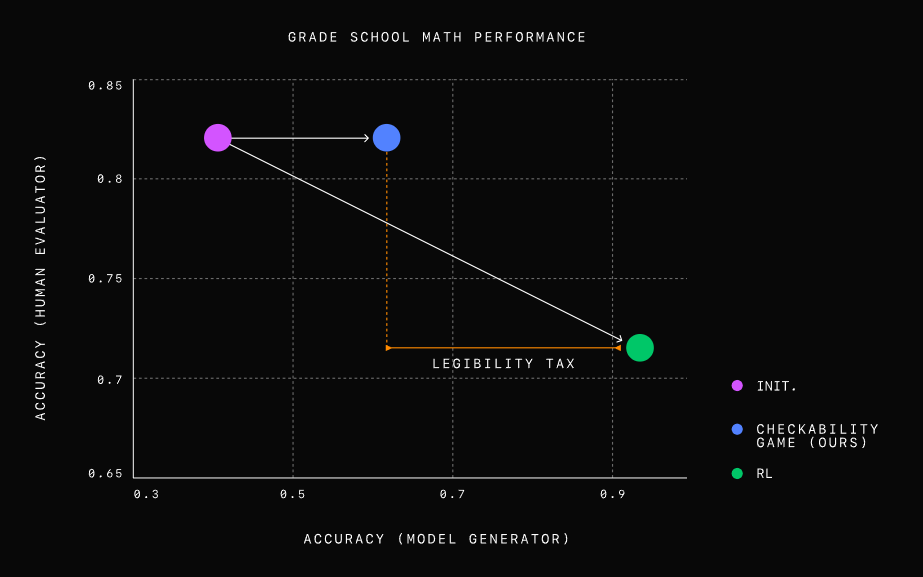

Araştırmacılar yöntemlerini ilkokul matematik problemlerinde test ettiler. Sadece doğruluk için optimize edilmiş bir modelin doğru ancak anlaşılması zor çözümler ürettiğini buldular. İnsan değerlendiriciler, bu çözümleri değerlendirirken yeni yaklaşım kullanılarak üretilenlere kıyasla neredeyse iki kat daha fazla hata yaptılar.

Kanıtlayıcı-doğrulayıcı oyunlar doğruluk ve netlik arasında iyi bir denge sağladı. Çözümler hala oldukça doğruydu ancak anlaşılması çok daha kolaydı.

Sonuç olarak, kanıtlayıcı onu kandırmaya çalışsa bile doğruyu yanlıştan güvenilir bir şekilde ayırabilen güçlü bir doğrulayıcı, insanların hataları fark etmesini kolaylaştıran faydalı bir kanıtlayıcıyla birleştiğinde güçlü bir araç olabilir.

OpenAI ekibi bu yöntemi, sonuçları doğru ve şeffaf bir şekilde doğrulanabilen AI sistemleri geliştirmenin umut verici bir yolu olarak görüyor. Bu, AI uygulamalarına olan güveni artırabilir ve doğruluk ve izlenebilirliğin hayati önem taşıdığı tıp, finans ve hukuk gibi kritik alanlarda kullanımlarını genişletebilir.

Bir diğer avantaj ise yöntemin insan rehberliğine ve değerlendirmesine daha az dayanmasıdır. OpenAI, bunun doğrudan insan denetimi olmadan insan değerleri ve beklentileriyle güvenilir bir şekilde uyumlu olması gereken süper zeki AI sistemleri geliştirmek için önemli olduğunu yazıyor.

Yapayzeka.news’in hiçbir güncellemesini kaçırmamak için bizi Facebook, X (Twitter), Bluesky, LinkedIn, Instagram ve Whatsapp Kanalımız‘dan takip edin.