Japon start-up’ı Rhymes AI, dünyanın ilk açık kaynaklı, çok modlu uzman karışımı modeli olduğunu iddia ettiği Aria’yı yayınladı. Aria’nın, karşılaştırılabilir büyüklükteki açık ve ticari uzmanlaşmış modellerle aynı seviyede veya daha iyi olduğu öne sürülüyor.

Tokyo merkezli bir AI girişimi olan Rhymes AI, ilk AI modeli Aria’yı açık kaynaklı yazılım olarak yayınladı. Şirkete göre Aria, dünyanın ilk açık kaynaklı, çok modlu Uzmanlar Karışımı (MoE) modeli.

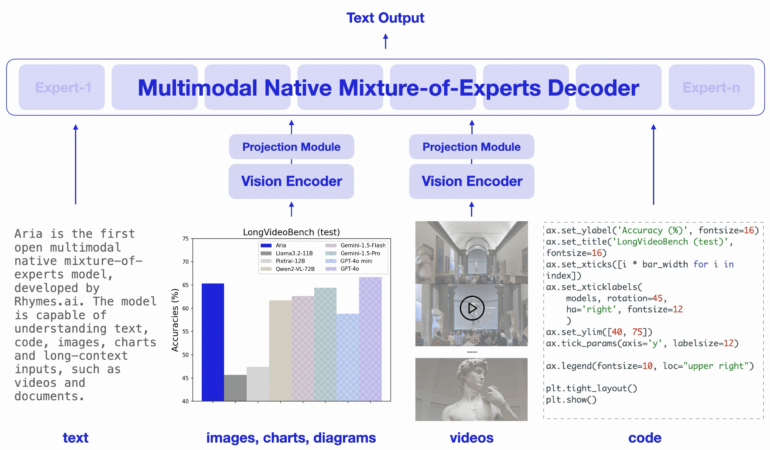

Rhymes AI, doğal olarak çok modlu modeli, metin, kod, görüntü ve video gibi birden fazla girdi biçiminde karşılaştırılabilir kapasiteye sahip özel modellerin anlama kapasiteleriyle eşleşen veya onları aşan bir model olarak tanımlıyor.

MoE modelleri, bir transformatörün ileri besleme katmanlarını birden fazla uzmanlaşmış uzmanla değiştiriyor. Her giriş belirteci için, bir yönlendirici modülü uzmanların bir alt kümesini seçerek belirteç başına etkin parametre sayısını azaltır ve hesaplama verimliliğini artırıyor. Bu sınıfın iyi bilinen temsilcileri arasında Mixtral 8x7B ve DeepSeek-V2 bulunuyor. GPT-4’ün de muhtemelen bu mimariye dayandığı varsayılıyor.

Aria’nın MoE kod çözücüsü, metin belirteci başına 3,5 milyar parametreyi etkinleştiriyor ve toplam 24,9 milyar parametreye sahip. 438 milyon parametreye sahip hafif bir görsel kodlayıcı, değişken uzunluk, boyut ve en boy oranına sahip görsel girdileri görsel belirteçlere dönüştürüyor. Aria, 64.000 belirteçten oluşan çok modlu bir bağlam penceresine sahip.

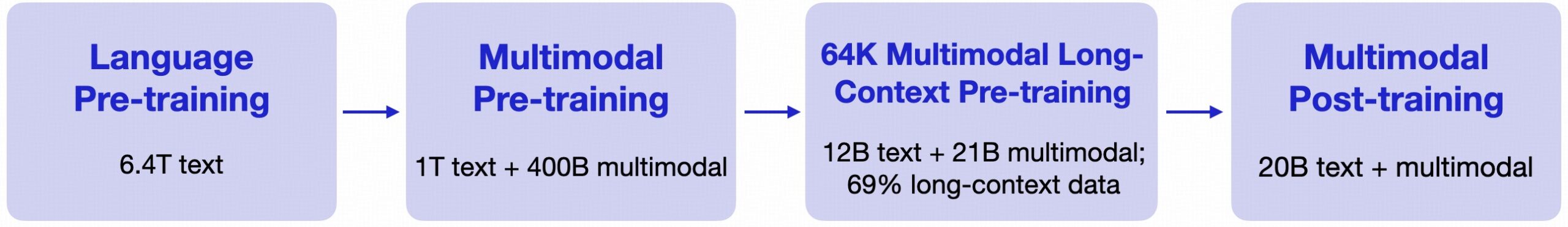

Rhymes AI, Aria’yı dört aşamada önceden eğitti: ilk önce yalnızca metin verileriyle, ardından metin ve çok biçimli verilerin karışımıyla, ardından uzun dizilerle eğitimle ve son olarak da son bir akortla.

oplamda Aria, 6,4 trilyon metin belirteci ve 400 milyar çok modlu belirteçle önceden eğitildi. Malzeme, diğerlerinin yanı sıra Common Crawl ve LAION’dan gelen iyi bilinen veri kümelerinden geliyor ve kısmen sentetik olarak zenginleştirildi.

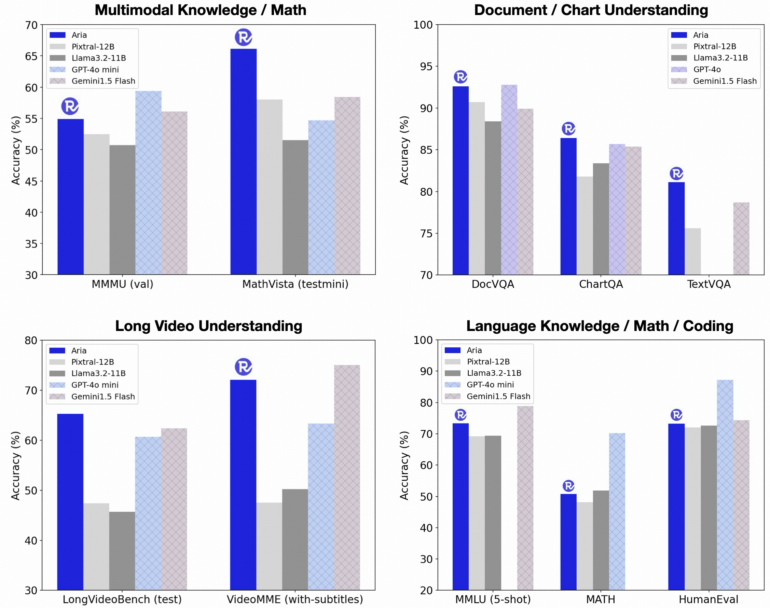

Pixtral-12B ve Llama-3.2-11B gibi modellerle karşılaştırıldığında, Aria, daha az sayıda etkinleştirilmiş parametre nedeniyle daha düşük çıkarım maliyetleriyle, kıyaslamalara göre çeşitli çok modlu, dilbilimsel ve programlama görevlerinde üstün performans gösteriyor. Ayrıca, Aria, çeşitli çok modlu görevlerde GPT-4o ve Gemini-1.5 gibi tescilli modellerle de başa çıkabilmeli.

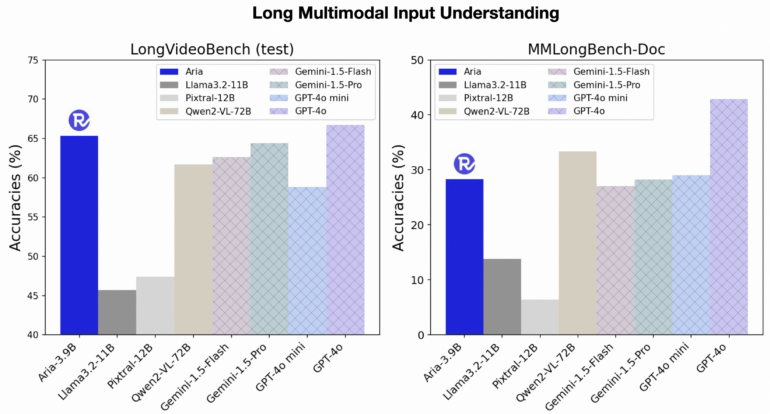

Rhymes AI’ya göre Aria, altyazılı videolar veya çok sayfalı belgeler gibi uzun çok modlu girdilerle de iyi sonuçlar elde ediyor. Diğer açık kaynaklı modellerin aksine, Aria’nın uzun videoları GPT-4o mini’den ve uzun belgeleri Gemini 1.5 Flash’tan daha iyi anladığı söyleniyor.

Rhymes AI, AMD ile iş birliği yapıyor

Rhymes AI, Aria’nın kaynak kodunu hem akademik hem de ticari kullanıma izin veren Apache 2.0 lisansı altında GitHub’da kullanıma sundu. Şirket, benimsenmesini kolaylaştırmak için Aria’nın tek bir GPU kullanılarak çeşitli veri kaynakları ve formatlarında ince ayar yapılmasına olanak tanıyan bir eğitim çerçevesi de yayınladı.

Rhymes AI, eski Google AI uzmanları tarafından kuruldu. Diğer bazı yükselen AI şirketlerine benzer şekilde, amacı herkesin erişebileceği güçlü modeller geliştirmek. Şirket, tohum sermayesi olarak 30 milyon ABD doları aldı.

Rhymes AI, AMD donanımını kullanarak modellerinin performansını optimize etmek için çip üreticisiyle bir ortaklığa girdi. AMD’nin “Advancing AI 2024” konferansında Rhymes AI, tüketiciler için geliştirilen ve AMD’nin MI300X hızlandırıcısında çalışan ve Rhymes AI’ya göre metin ve resimler için kapsamlı AI arama sonuçları sunan BeaGo arama uygulamasını sundu.

BeaGo bir videoda kendini Perplexity ve Gemini ile karşılaştırıyor. Şu anda iOS ve Android için ücretsiz olarak sunulan uygulama, arama motoru bağlantısına ek olarak yalnızca metin ve İngilizce ses girişini destekliyor gibi görünüyor. Ayrıca güncel haberlerin AI özetlerini ve çeşitli çevrimiçi makalelere bağlantılar öneriyor.

Kaynak: The Decoder

Yapayzeka.news’in hiçbir güncellemesini kaçırmamak için bizi Facebook, X (Twitter), Bluesky, LinkedIn, Instagram ve Whatsapp Kanalımız‘dan takip edin.